去學習出一套專家系統,之後便可以不加思索的運用這套專家系統,

完成用言語無法傳授、無法靠理論學習的特殊技能。

人腦的模式學習能力其實非常強,只要輸入大腦的訊號有一定的規則,

我們就有機會能夠自動學會、並辨認出其背後的涵義。

而如果我們能善用大腦這種與外界互動的歸納學習能力,便有機會

將自己的意識、身體空間感往外界延伸,並且獲得非與生俱來的能力,

得到體感的延伸。

車子的行動似乎跟手腳連在一起,對車子的空間感也非常熟悉,

能夠精準抓出車體前後左右和其他物體的距離,這就是體感延伸的一個例子。

體感延伸除了像開車這種簡單的空間感連結,還包括其他感官的延伸擴充。

大家都知道蝙蝠可以透過自己發出超聲波的反射,來知道物體的遠近和大小,

快速遨遊飛翔在完全漆黑的洞穴之中。

這種蝙蝠的特殊功能,應該是可以透過注意聽取周遭的聲音,便能慢慢習得,

也就是說,盲眼人應該可以自然而然的用耳朵代替眼睛,用耳朵"看到"周圍的一切。

但這個狀況並沒有發生在大部分的盲人身上,為什麼?

其實原因很單純,大部分的盲人他們聽到的聲音,並不是由自己發出的(不像蝙蝠)。

這些聲源位置不固定、大小不固定、頻率不固定--因此它們反射給使用者的聲音,

當然也是不固定、沒有規則可言的(在未知聲源遠近和大小的情況下)。

想像我們一出生的時候,便處在一個全黑的世界中,這個世界有時候會有光明出現,

有時候我們左手邊會有橘色燈光照射一兩秒,有時右上藍色燈光閃兩下,

在這種情況下,其實我們很難去連結視覺和這整個世界的環境。

但假如給我們一個光源穩定的手電筒呢? 我們將這支手電筒放在我們的頭上,

像是探照燈一樣,照向我們要看的地方,如此一來我們就有一個恆定的訊號發射台,

我們也就能夠獲得真正"有規則"的資訊,進而讓我們的大腦學習這世界的樣貌。

所以,其實盲人要能夠"看"到,只需要他們能夠接收到一種有規則的資訊,

這種有規則的資訊若能夠將周圍環境的空間訊息表達出來,他們便能慢慢學會。

(假如對數學物理有一些研究的話,很像是對n維向量做不同空間的Mapping,

只要資訊沒有遺失,或遺失的很少,那轉換後的向量便可以組合出原本的圖形。

類似任何波形都可以用傅立葉轉換後的向量來表示一樣。)

要產生這種有規則的資訊目前我知道有兩種做法,一種是讓人類像海豚一樣,

利用舌頭不斷地打出Da Da Da的聲音(像是頭上的手電筒一般),

並藉由這個訊號的反射去學習周圍環境的一切。

像是下面影片中的Ben Underwood一樣。

Ben是個盲人,由於他的眼眶中沒有眼睛,因此他需要帶義眼才能看起來像個正常人,

但他藉由用舌頭打出聲音,反射周圍的景色,進而掌握周圍環境的一切,

若看上面的影片,你很難相信他看不見,他能夠溜直排輪(0:47)、騎腳踏車

精準辨認筆筒大小物體的高度、基礎形狀(8:20),一切只靠聽取簡單的打舌反射聲。

而另外一個獲得外界資訊的方法,就是使用攝影機來代替人眼觀察周圍環境,

並將它轉成人類可接收到的電子訊號。

有個叫BrainPort的裝置 (簡單的中文介紹),它將攝影機錄到的影像,

經過特別的處理轉成電子訊號,送到一個有600個電極的小板子上,

使用者只要將小板子含在舌頭上,利用舌頭上濃密的神經接收這些訊號,

便可以產生"既視感"(好像看到了什麼東西。)

盲人(以及正常人)只要經過2到10小時的訓練,便可透過這個裝置"看到"周圍的環境,

辨別各物體的形狀。

上面是盲人實際使用BrainPort的影片,可以從大約0:26之後開始看,

片中的盲人透過這個裝置可以辨認字卡上的文字、辨認桌上杯子的位置、

辨認出移動中物體的位置、和女兒玩圈圈叉叉。

從上面感官延伸的例子中可以看出,人腦可以透過鍛鍊,從輸入資訊擷取規律,

轉化成自己能理解的東西,進而做到感官延伸。於是經過鍛鍊後,

盲眼的人可以透過聽覺、觸覺,看到周圍的一切。

有趣的是,其實人腦也能解讀自己運作的規則,進而操縱自己。

只要外界有足夠的的資訊可以讓大腦了解自己運作的狀況,

大腦就能控制自己,讓自己觀察到的狀況再度發生。

假設有一個燈泡,在我們有得意的感覺時就會亮紅色,深度恐懼的時候就會亮藍色。

一開始我們不知道這個規則,但後來我們誤打誤撞的讓紅色和藍色燈各亮了幾次,

接著我們就可以有意識的控制大腦,去嘗試讓藍色和紅色的燈再度亮起,

一旦我們抓到了訣竅,我們就可以自由地控制紅藍燈的開關

--同時我們也等同於自由的控制了自己的大腦。

舉些在現實生活中實現的例子好了:

假如我們在人腦中植入電極,讀取人腦產生的訊號(微小的電流),

利用這些電流去操縱一些東西,例如電腦中的滑鼠,

那麼我們可以觀察滑鼠的移動,去歸納出什麼樣的想法(或感覺),

可以讓滑鼠移到什麼地方去,進而去利用這樣的想法和感覺去移動滑鼠。

(用電子學的說法叫做Feedback學習)

隨著科技的進步,我們可以不用侵入腦部,只要將電極放在頭的外部,

像是在頭上戴上一個簡單的爪狀頭盔,便可以讀取腦部的電流活動,

進而達到操縱外界裝置的效果。(這個裝置稱為Emotiv)

這個裝置能夠讓使用者用想法控制一些簡單的裝置,例如讓電腦中的圖形消失、旋轉,

玩Angry Bird、用電腦玩慢速乒乓球等等...

除了觀察外在物品外,假如我們直接觀察腦部的活動,也能學會如何控制大腦。

一場TED演講中提到,利用核磁共振我們可以即時的看到我們大腦中的活動,

如此一來我們就能透過觀察螢幕顯示的資訊,去學習自由激活(activate)、

或是抑制(deactivate)大腦神經的活動。

在應用上,人們可以學習抑制大腦的疼痛迴路,減少疼痛的產生。

總結來說,透過接收有規則的資訊訓練大腦,我們有機會可以做到:

1. 發展出本來不存在的感官: 我們可以利用轉化過的電子訊號或音波聽到、

感覺到周圍的空間分布,代替或延伸我們的視覺。

2. 藉由觀察自己的大腦變化,來達到控制自己的情緒、感覺、生理反應,

即使一開始我們不知道怎麼操作,但我們可以學會。

3. 用自己的大腦訊號控制外在的物體,就像是使用念力一般。

這篇文中的2.2~2.6節提到非常類似的想法。

有一部分聽起來有點超現實,但其實這些都已經在現實中被初步實現。

順道一提,現在有一種義肢叫做 iLimb,它可以直接套在截肢人的斷臂處,

而使用者可以透過頭腦去發出訊號(不是肌肉牽動機關),讓義肢做出不同的動作,

義肢可以做到發紙牌、撥香蕉皮、握手、提公事包等細膩、力量大小差距極大的動作,

這也是感官延伸的一個例子。

我認為,其實現在這種人類感官延伸的技術,只要在人腦和外界訊號的溝通上,

能夠做到更即時、資訊量更多、更少雜訊,那麼我們就可以更清楚的感知外界,

(盲眼的人能夠看得更清楚),而人腦對外界也能做出更精確的操作,

不再是只能做出用滑鼠兩三秒就能做到的簡單動作,而是更複雜,

更無法言喻的複雜操作,像是玩射擊遊戲、即時戰略,編輯文件等等。

現在大腦和外界兩邊資訊的溝通,假如要用網際網路來做比喻的話,

資訊傳遞的能力大概只像電話撥接的速度跟品質,我想,

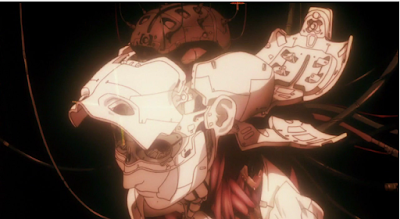

只要我們能夠進步到光纖等級的溝通品質,未來的世界可能就有機會像

攻殼機動隊裡所描述的一樣,人和電腦的連結和操作越來越緊密,

電腦可以成為人的義體,而什麼是人、靈魂、思想,

則會成為一個新的哲學問題。

附錄:

攻殼機動隊是一部日本動畫,描述在未來人們可以讓人腦和電腦溝通,

因此人的身上可以配戴或替換部份的肢體為"義體"(機械電子裝置),

而動畫主角是一名"全身義體化"(只剩腦部是肉身)的女性特勤人員。

個人認為是一部有點現代史詩感、發人深省的日本動畫。

2012.9.18更新

美國研究出戴在手上的感知手套,也就是利用手套上的電子感應器,去感知觸摸表面的電子性質以及其他特性。於是醫生可以藉由直接觸摸患者組織,即能知道這個組織是否病變。

(from: http://pansci.tw/archives/27249)

2014.4.27更新

全色盲男子Neil Harbisson把影像轉成聲音,利用機器鏡頭來當作自己的眼睛,以聽覺來做視覺的延伸。

很棒!格裡的文章都寫的都不錯呢! 很合我胃口,也請再多多分享喔。

回覆刪除謝謝~

回覆刪除我也希望之後能夠學到更多,

再分享一些心得給大家!!

獲益良多

回覆刪除現在有一種義肢叫做 iLimb,它可以直接套在截肢人的斷臂處

回覆刪除哇!鋼之鍊金術師的機械鎧真人版啊!

(這個裝置稱為Emotiv)

之後的發展應該就是夢境RPG遊戲,不然就是用於軍事訓練了。